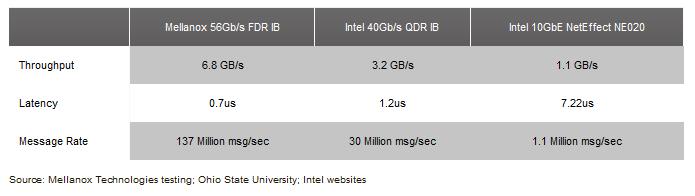

Las soluciones basadas en Infiniband, se caracterizan por habilitar la comunicación entre dispositivos (almacenamientos, nodos de cálculo, servidores de altas prestaciones) a unas tasas de transferencia sin rival y una latencia muy baja.

Cuando se puede utilizar Infiniband

Es utilizado en los más potentes clusters de supercomputación (TOP500), EDC (Enterprise Data Centers), Web 2.0 y Cloud Computing.

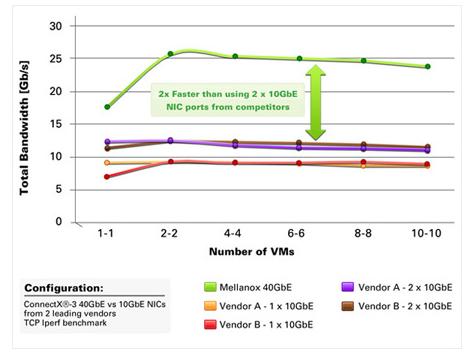

En soluciones de virtualización, Infiniband también es mucho más eficiente que cualquier otra solución de conectividad. Los últimos dispositivos basados en el protocolo VPI (Virtual Protocol Interconnect) están adaptados para que cualquier puerto pueda operar como Infiniband, Ethernet o DCB (Data Center Bridging), soportando de este modo las siguientes configuraciones:

- Ethernet sobre Infiniband (EoIB).

- Fibre Channel sobre Ethernet (FCoE).

- RDMA sobre Converged Ethernet (RoCE).

Infiniband al detalle

ConnectX-3 permite diseñar soluciones “end to end” a 56Gb/s, escenarios ideales para entornos HPC, biociencia, diseño asistido, sistemas de fabricación, previsión meteorológica, defensa, Big Data, Web 2.0, HPPC, Memcache, COTD (Cloud Online Transaction Database), almacenamientos High End y un largo etcétera.

Una característica de los puertos basados en VPI, es que cada puerto se puede configurar como Infiniband a 56 Gb/s o como Ethernet hasta 40 Gb/s, permitiendo una convergencia real de la fabric.

Con un impacto de carga inferior al 5% sobre las CPU´s y con latencias de 1 micro segundo, consiguen tasas de transferencia reales de 12GB/s (96 Gb/s) en sistemas de almacenamiento.

No dudes en consultar tu configuracion a medida!

Productos

Tarjetas Mellanox Infiniband y Ethernet:

Las tarjetas Mellanox se diferencian entre si por 3 aspectos tecnicos.

– Tipo de red: Pueden ser Infiniband, Ethernet, e incluso algunas versiones con VPI permiten trabajar en ambas redes indistintamente.

– Velocidad: Dentro de las HCAs Infiniband se distinguen DDR 20Gb/s, QDR 40Gb/s y FDR 56Gb/S. Asi mismo las tarjetas Mellanox VPI con doble personalidad Infiniband/EThernet pueden trabajar a 10GbE las QDR, y 40/56GbE las FDR.

– Conexiones: la conexion mas habitual para Infiniband es QSFP (CX4 en tarjetas antiguas), mientras que para Ethernet de baja latencia encontramos SFP+ para velocidades de 10Gb/s, y QSFP para 40Gb/s y superiores.

Aunque la practica totalidad de las tarjetas cuenta con un PCI-E x8 3.0, existe un modelo en PCI-E x16 que alcanza los 100Gb/s utilizando doble puerto.

| Modelo | Speed | Ports | Connectors | ASIC & PCI Dev ID | PCI | Lanes |

| Mellanox ConnectX-2 VPI Adapter Cards | ||||||

| MHQH19B-XTR | QDR and 10GbE | 1 | QSFP | ConnectX-2 26428 | PCle 2.0 | x8 |

| MHQH29C-XTR | QDR and 10GbE | 2 | QSFP | ConnectX-2 26428 | PCle 2.0 | x8 |

| MHRH19B-XTR | DDR and 10GbE | 1 | QSFP | ConnectX-2 25418 | PCle 2.0 | x8 |

| MHRH29C-XTR | DDR and 10GbE | 2 | QSFP | ConnectX-2 26418 | PCle 2.0 | x8 |

| MHZH29B-XTR | QDR and 10GbE | 1 and 1 | QSFP and SFP+ | ConnectX-2 26428 | PCle 2.0 | x8 |

| Mellanox ConnectX-3 VPI Adapter Cards | ||||||

| MCX353A-QCBT | QDR and 10GbE | 1 | QSFP | ConnectX-3 4099 | PCle 3.0 | x8 |

| MCX354A-QCBT | QDR and 10GbE | 2 | QSFP | ConnectX-3 4099 | PCle 3.0 | x8 |

| MCX353A-TCBT | FDR10 and 10GbE | 1 | QSFP | ConnectX-3 4099 | PCle 3.0 | x8 |

| MCX354A-TCBT | FDR10 and 10GbE | 2 | QSFP | ConnectX-3 4099 | PCle 3.0 | x8 |

| MCX353A-FCBT | FDR and 40GbE | 1 | QSFP | ConnectX-3 4099 | PCle 3.0 | x8 |

| MCX354A-FCBT | FDR and 40GbE | 2 | QSFP | ConnectX-3 4099 | PCle 3.0 | x8 |

| Mellanox ConnectX-4 VPI Adapter Cards | ||||||

| MCX455A-ECAT | EDR IB (100Gb/s) and 100 Gb | 1 | QSFP | ConnectX-4 adapted card | PCle 3.0 | x16 |

| MCX456A-ECAT | EDR IB (100Gb/s) and 100 Gb | 2 | QSFP | ConnectX-4 adapted card | PCle 3.0 | x16 |

| MCX455A-FCAT | FDR IB (56Gb/s) and 40/56GbE | 1 | QSFP28 | ConnectX-4 adapted card | PCle 3.0 | x16 |

| MCX456A-FCAT | FDR IB (56Gb/s) and 40/56GbE | 2 | QSFP28 | ConnectX-4 adapted card | PCle 3.0 | x16 |

| MCX453A-FCAT | FDR IB (56Gb/s) and 40/56GbE | 1 | QSFP28 | ConnectX-4 adapted card | PCle 3.0 | x8 |

| MCX454A-FCAT | FDR IB (56Gb/s) and 40/56GbE | 2 | QSFP28 | ConnectX-4 adapted card | PCle 3.0 | x8 |

| Mellanox ConnectX-IB | ||||||

| MCB193A-FBAT | FDR IB (56Gb/s) | 1 | QSFP | ConnectX-IB | PCle 2.0 | x16 |

| MCB191A-FCAT | FDR IB (56Gb/s) | 1 | QSFP | ConnectX-IB | PCle 3.0 | x8 |

| MCB194A-FCAT | FDR IB (56Gb/s) | 2 | QSFP | ConnectX-IB | PCle 3.0 | x16 |

Switches:

Switches Mellanox:

Mellanox dispone actualmente varias gamas de Switches, que se diferencian entre si por la generacion del Chipset, numero de puertos, velocidad y tipo de red que puede ser Infiniband, Ethernet de baja latencia y los denominados Bridge que permiten ambas cosas.

Al igual que las tarjetas la conexion mas habitual para Infiniband es QSFP mientras que para Ethernet de baja latencia encontramos SFP+ para velocidades de 10Gb/s, y QSFP para 40Gb/s y superiores.

Switches Infiniband:

La gama IS5000 son la 4ª generacion, y primera con velocidad QDR.

La gama SX65XX esta basada en Chipset de 5ª generacion, y primera version con FDR.

La gama SX60XX esta basada en el chipset de 6ª Generacion SwitchX-2, de momento solo esta disponible para equipos hasta 36 puertos y destaca porque permite redes Infiniband nativamente y opcionalmente Ethernet.

| IS5022 | IS5023 | IS5024 | IS5025 | SX6005 | SX6025 | |

| Ports | 8 | 18 | 36 | 36 | 12 | 36 |

| Height | 1U | 1U | 1U | 1U | 1U | 1U |

| Switching Capacity | 640Gb/s | 1.44Tb/s | 2.88Tb/s | 2.88Tb/s | 1.34Tb/s | 4.032Tb/s |

| Link Speed | 40Gb/s | 40Gb/s | 40Gb/s | 40Gb/s | 56Gb/s | 56Gb/s |

| Management | No | No | No | No | No | No |

| Management Port | – | – | – | – | – | – |

| Console Cables | No | No | No | No | – | No |

| PSU Redundancy | No | Optional | Optional | Optional | No | Optional |

| Fan Redundancy | No | Optional | Optional | Optional | No | Optional |

| Integrated Gateway | – | – | – | – | – | – |

| SX6012 | SX6018 | IS5030 | IS5035 | 4036 | 4036E | SX6036 | |

| Ports | 12 | 18 | 36 | 36 | 36 | 34+2Eth | 36 |

| Height | 1U | 1U | 1U | 1U | 1U | 1U | 1U |

| Switching Capacity | 1.346Tb/s | 2.016Tb/s | 2.88Tb/s | 2.88Tb/s | 2.88Tb/s | 2.72Tb/s | 4.032Tb/s |

| Link Speed | 56Gb/s | 56Gb/s | 40Gb/s | 40Gb/s | 40Gb/s | 40Gb/s | 56Gb/s |

| Management | Yes

648 nodes |

Yes

648 nodes |

Yes

108 nodes |

Yes

648 nodes |

Yes

648 nodes |

Yes

648 nodes |

Yes

648 nodes |

| Management Port | 1 | 2 | 1 | 2 | 1 | 1 | 2 |

| Console Cables | – | Yes | Yes | Yes | Yes | Yes | Yes |

| PSU Redundancy | Optional | Optional | Optional | Optional | Optional | Optional | Optional |

| Fan Redundancy | No | Optional | Optional | Optional | Yes | Yes | Optional |

| Integrated Gateway | Optional | Optional | – | – | – | Yes | Optional |